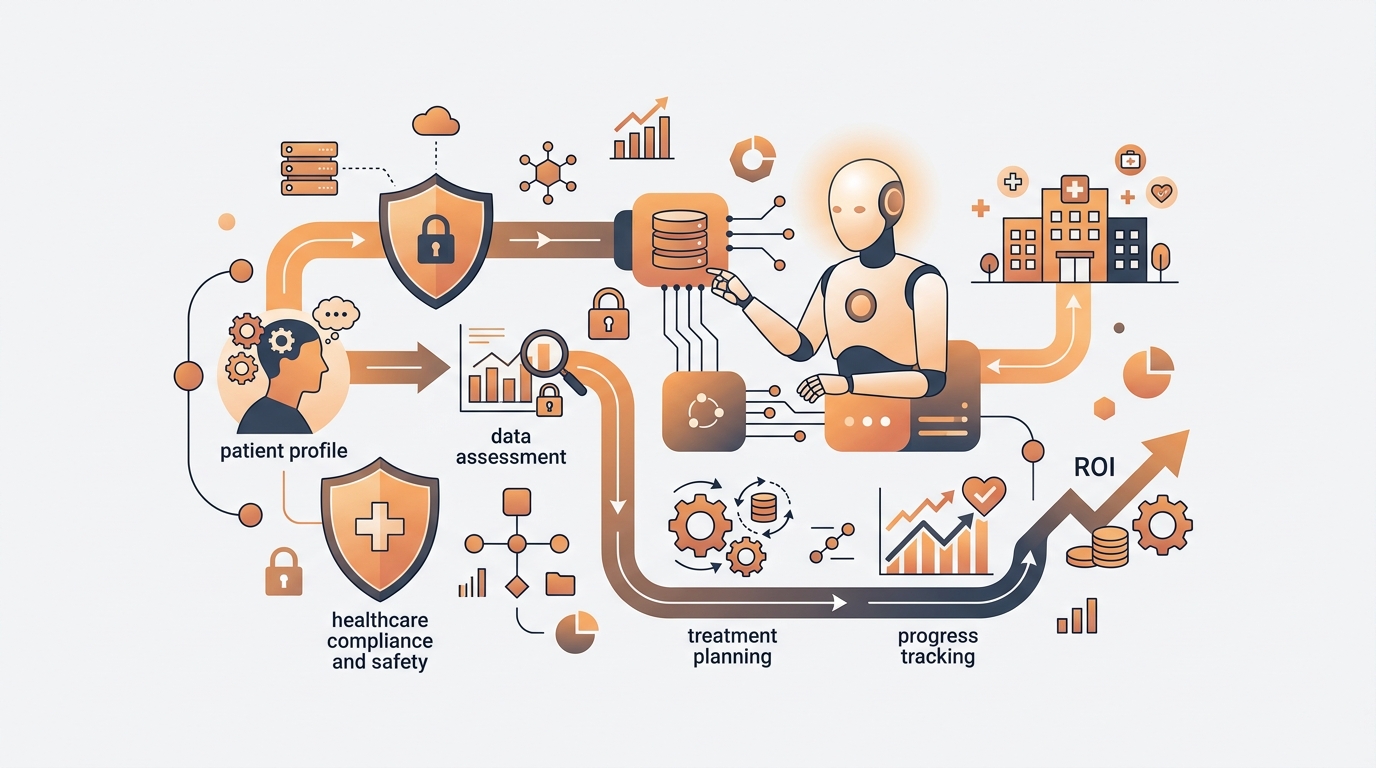

วิธีสร้าง AI Mental Health Workflow Implementation ที่ปลอดภัยและวัดผลได้จริง

คลินิกหลายแห่งสูญเสียเงินและเสี่ยงต่อข้อกฎหมายเพราะใช้ AI ผิดวิธี เรียนรู้วิธีวางระบบคัดกรองผู้ป่วยด้วย AI ที่ปกป้องข้อมูลส่วนบุคคลและส่งต่อเคสฉุกเฉินให้แพทย์ทันที

iReadCustomer Team

ผู้เขียน

เมื่อเดือนตุลาคมปีที่แล้ว เครือข่ายคลินิกสุขภาพจิตระดับภูมิภาคในรัฐโอไฮโอพลาดการตอบกลับผู้ป่วยช่วงกลางดึกถึง 412 ครั้ง เพราะระบบคัดกรอง (Triage) ของพวกเขาพึ่งพาพยาบาลวิชาชีพที่เหนื่อยล้าเพียงสองคน การวางระบบ ai สุขภาพจิตคลินิก (ai mental health workflow implementation) จึงไม่ใช่แค่เรื่องของเทคโนโลยี แต่เป็นการอุดรอยรั่วของรายได้และรักษามาตรฐานการดูแลผู้ป่วย

ต้นทุนแฝงมหาศาลเมื่อระบบคัดกรองสุขภาพจิตพังทลาย

ระบบคัดกรองผู้ป่วยที่ไร้ประสิทธิภาพคือสาเหตุหลักที่ทำให้คลินิกสูญเสียรายได้และบั่นทอนกำลังใจของบุคลากรทางการแพทย์ มันสร้างภาระงานเอกสารซ้ำซ้อนและทำให้ผู้ป่วยที่ต้องการความช่วยเหลือด่วนต้องรอคอยข้ามคืน การปล่อยให้จิตแพทย์หรือนักจิตวิทยาต้องมานั่งตอบคำถามพื้นฐานเรื่องเวลาทำการหรือสิทธิประกัน เป็นการเผาผลาญทรัพยากรที่แพงที่สุดในองค์กรของคุณ

รายงานจากสมาคมจิตแพทย์อเมริกันระบุว่า คลินิกสูญเสียรายได้เฉลี่ย 1.5 ล้านบาทต่อปีจากเคสที่หลุดลอยไปนอกเวลาทำการ บุคลากรทางการแพทย์ใช้เวลาเกือบ 30% ไปกับการจัดหมวดหมู่อาการผู้ป่วยใหม่ แทนที่จะได้ใช้เวลาเหล่านั้นในการบำบัดรักษาจริงๆ ความเหนื่อยล้าสะสมนี้ทำให้คลินิกต้องเผชิญกับอัตราการลาออกที่พุ่งสูงขึ้นอย่างต่อเนื่อง

ต้นทุนในการสรรหาและฝึกอบรมนักจิตวิทยาคนใหม่เพื่อทดแทนคนที่ลาออกนั้นสูงถึง 1.2 ล้านบาทต่อคน การแก้ปัญหาด้วยการจ้างพนักงานแอดมินเพิ่มรอบดึกก็ไม่ใช่ทางออกที่คุ้มค่าทางการลงทุน เพราะปริมาณคำถามไม่ได้คงที่ตลอดทั้งคืน

ช่องโหว่ของการรอคอยในยามวิกาล (The Midnight Crisis Gap)

ช่วงเวลาตีสองถึงตีห้าคือช่วงเวลาที่ผู้ป่วยมีความเปราะบางมากที่สุด แต่กลับเป็นช่วงที่คลินิกมีทรัพยากรในการตอบสนองน้อยที่สุด การปล่อยให้ผู้ป่วยเผชิญกับข้อความตอบกลับอัตโนมัติแบบเก่าสร้างความรู้สึกโดดเดี่ยวและอาจนำไปสู่อันตรายได้

รูปแบบของความสูญเสียเมื่อไม่มีระบบ ai เข้ามาช่วยจัดการ:

- ผู้ป่วยใหม่ 45% ยกเลิกความตั้งใจในการนัดหมายหากไม่ได้รับการตอบกลับภายใน 1 ชั่วโมง

- ทีมแพทย์ต้องใช้เวลาช่วงเช้า 2 ชั่วโมงแรกเพื่อเคลียร์ข้อความตกค้างจากเมื่อคืน

- เกิดความเสี่ยงทางกฎหมายหากผู้ป่วยส่งข้อความวิกฤตแล้วไม่มีใครเห็นจนกระทั่งเช้า

- เสียค่าใช้จ่ายล่วงเวลา (OT) ให้กับพยาบาลคัดกรองโดยไม่จำเป็นในคืนที่ไม่มีเคสหนัก

- คลินิกคู่แข่งที่ใช้ระบบอัตโนมัติสามารถดึงตัวผู้ป่วยที่ต้องการคำปรึกษาด่วนไปได้

ผลกระทบต่ออัตราการลาออกของแพทย์

แพทย์และนักบำบัดไม่ได้เรียนมาเพื่อเป็นพนักงานคอลเซ็นเตอร์ การให้พวกเขาต้องรับภาระตอบคำถามจุกจิกคือสูตรสำเร็จของภาวะหมดไฟ (Burnout) ที่ผู้บริหารคลินิกมักมองข้าม

- แพทย์ใช้เวลาเฉลี่ย 15 นาทีต่อเคสเพียงเพื่อสอบถามประวัติพื้นฐานซ้ำๆ

- การต้องสลับโหมดจากการบำบัดเชิงลึกมาจัดการงานธุรการทำให้สมาธิในการทำงานลดลง

- อัตราความพึงพอใจในงาน (Job Satisfaction) ลดลง 40% เมื่อต้องทำงานนอกเวลา

- ผู้ป่วยรู้สึกว่าแพทย์รีบร้อน เพราะแพทย์มีเวลาจำกัดในการคุยเรื่องสำคัญ

- ต้นทุนค่าเสียโอกาส (Opportunity Cost) ของชั่วโมงบำบัดที่หายไปมีมูลค่ามหาศาล

ทำไมการใช้ AI ในคลินิกจึงต้องมีกรอบธรรมาภิบาลที่เข้มงวด

AI สำหรับงานสุขภาพจิตคือระบบจัดคิวและส่งต่อข้อมูล ไม่ใช่เครื่องมือสำหรับวินิจฉัยโรคหรือให้คำปรึกษาแทนแพทย์ มันจำเป็นต้องมีกรอบการทำงาน (Governance) ที่ชัดเจน เพราะการปล่อยให้บอทให้คำแนะนำทางการแพทย์โดยไม่ตั้งใจ อาจทำให้คลินิกถูกฟ้องร้องจนต้องปิดกิจการได้

ผู้บริหารคลินิกหลายคนทำพลาดด้วยการนำแชทบอทสำเร็จรูปทั่วไปมาใช้กับผู้ป่วย โดยไม่ได้ตระหนักว่าข้อมูลสุขภาพมีความละเอียดอ่อนกว่าข้อมูลลูกค้าอีคอมเมิร์ซ กฎหมายคุ้มครองข้อมูลส่วนบุคคลอย่าง PDPA หรือ HIPAA กำหนดโทษปรับหลักล้านบาทหากข้อมูลประวัติการรักษาหลุดรอดออกไป คุณต้องออกแบบระบบให้ AI ทำหน้าที่เป็นเพียง "ผู้ช่วยธุรการ" ที่ไม่เคยก้าวล่วงขอบเขตทางวิชาชีพ

ความเสี่ยงทางกฎหมายจะลดลงทันทีเมื่อคุณตั้งค่าโปรแกรมให้ปฏิเสธการให้คำปรึกษา (Not medical advice) อย่างเด็ดขาด ระบบ AI ที่ดีที่สุดคือระบบที่รู้จักปฏิเสธผู้ป่วยอย่างสุภาพและส่งต่อให้มนุษย์เมื่อเกินขอบเขตหน้าที่

การกำหนดขอบเขตห้ามให้คำแนะนำทางการแพทย์

บอททั่วไปถูกฝึกมาให้เอาใจคู่สนทนา ซึ่งเป็นอันตรายมากในบริบทของสุขภาพจิต เพราะบอทอาจแต่งเรื่อง (Hallucinate) หรือให้คำแนะนำเกี่ยวกับยาที่ผิดพลาดได้

สิ่งที่ต้องบังคับใช้ในระบบ ai mental health workflow implementation:

- ขึ้นป้ายเตือน (Disclaimer) อย่างชัดเจนก่อนเริ่มแชทว่านี่คือระบบคัดกรอง ไม่ใช่แพทย์

- บล็อกคำศัพท์ที่เกี่ยวกับการสั่งยา การปรับโดสยา หรือการวินิจฉัยโรคโดยเด็ดขาด

- หากผู้ป่วยถามอาการ AI ต้องตอบกลับด้วยชุดคำตอบมาตรฐานที่แพทย์รับรองเท่านั้น

- ห้าม AI สรุปสาเหตุของอาการทางจิตใจด้วยตัวเอง

- บันทึกทุกบทสนทนา (Audit Trail) แบบแก้ไขไม่ได้ เพื่อใช้เป็นหลักฐานทางกฎหมาย

โครงสร้างความเป็นส่วนตัวและการขอความยินยอม (Privacy and Consent)

ข้อมูลสุขภาพจิตคือข้อมูลส่วนบุคคลอ่อนไหว (Sensitive Data) คุณไม่สามารถนำข้อมูลเหล่านี้ไปโยนใส่โมเดล AI สาธารณะเพื่อประมวลผลได้โดยพลการ

- ผู้ป่วยต้องกดปุ่มยินยอม (Explicit Consent) เพื่อรับทราบว่ากำลังคุยกับระบบอัตโนมัติ

- ข้อมูลทั้งหมดต้องถูกเข้ารหัส (Encryption) ทั้งระหว่างทางและปลายทางจัดเก็บ

- สิทธิ์ในการเข้าถึงประวัติแชทจะต้องจำกัดเฉพาะแพทย์เจ้าของไข้และแอดมินระดับสูง

- ตั้งระบบลบข้อมูลส่วนตัว (PII Stripping) เช่น ชื่อ เบอร์โทร ออกก่อนส่งไปประมวลผล

- มีปุ่มให้ผู้ป่วยสามารถขอลบข้อมูลประวัติการสนทนาของตนเองได้ตลอดเวลา

การเตรียมความพร้อมของข้อมูลและออกแบบขั้นตอนการทำงาน

ความพร้อมของข้อมูล (Data Readiness) คือตัวชี้วัดว่าระบบ AI ของคุณจะเป็นผู้ช่วยชั้นเลิศหรือตัวถ่วงขององค์กร มันทำงานโดยการวิเคราะห์ประวัติการสอบถามเก่าๆ เพื่อจับคู่คำถามของผู้ป่วยเข้ากับหมวดหมู่อาการที่ถูกต้องได้อย่างแม่นยำ

คลินิกส่วนใหญ่มีข้อมูลผู้ป่วยกระจัดกระจายอยู่ในกระดาษ ไฟล์ Excel และระบบจัดการคลินิก (HIS) แบบเก่า การนำ AI มาครอบทับกระบวนการที่ยุ่งเหยิงจะยิ่งทำให้ระบบพังเร็วขึ้น คุณต้องเริ่มจากการทำแผนผังเส้นทางผู้ป่วย (Patient Journey Mapping) ตั้งแต่ทักแชทเข้ามาครั้งแรก จนถึงการนัดหมายและชำระเงิน

การออกแบบ workflow ที่ดีต้องระบุได้ว่าจุดใด (Touchpoint) ที่ปลอดภัยพอจะให้ AI จัดการ และจุดใดที่ต้องใช้มนุษย์ หากคลินิกของคุณยังไม่สามารถสรุปกระบวนการรับผู้ป่วยออกมาเป็นข้อๆ ได้ คุณก็ยังไม่พร้อมที่จะติดตั้งระบบ AI ใดๆ ทั้งสิ้น

การประเมินความพร้อมของฐานข้อมูลคลินิก

AI ต้องการข้อมูลตัวอย่าง (Training Data) ที่สะอาดและมีโครงสร้างชัดเจน เพื่อให้มันเข้าใจบริบทเฉพาะของคลินิกคุณ เช่น วิธีการเรียกชื่อแพ็กเกจบำบัด หรือชื่อของแพทย์แต่ละท่าน

รายการตรวจสอบ mental health data readiness checklist:

- รวบรวมแชทหรืออีเมลสอบถามย้อนหลัง 6 เดือนเพื่อดูคำถามที่พบบ่อยที่สุด 20 อันดับ

- แยกแยะประเภทคำถามออกเป็น งานธุรการ อาการเบื้องต้น และฉุกเฉิน

- สร้างฐานข้อมูลคำตอบ (Knowledge Base) ที่อนุมัติโดยผู้อำนวยการคลินิก

- ทำความสะอาดข้อมูล (Data Cleansing) ลบชื่อผู้ป่วยเก่าออกจากตัวอย่างการฝึกสอน

- จัดทำรายชื่อบริการและตารางเวลาของแพทย์ให้อยู่ในรูปแบบ API ที่ดึงข้อมูลได้ง่าย

การระบุจุดสัมผัสบริการที่ปลอดภัยสำหรับ AI

ไม่ใช่ทุกขั้นตอนที่ควรใช้ AI คุณต้องเลือกเฉพาะขั้นตอนที่เป็นคอขวดและไม่มีความเสี่ยงทางการแพทย์มาทำระบบอัตโนมัติก่อน

- การตอบคำถามเรื่องเวลาทำการ แผนที่ และสิทธิประกันสังคมหรือประกันเอกชน

- การทำแบบประเมินสุขภาพจิตเบื้องต้น (เช่น PHQ-9) ก่อนพบแพทย์

- การส่งแจ้งเตือนเพื่อนัดหมายล่วงหน้าและยืนยันการเข้ารับบริการ

- การส่งแบบสอบถามความพึงพอใจและการติดตามอาการทั่วไปหลังการรักษา

- การรวบรวมประวัติการแพ้ยาหรือข้อมูลทางประชากรศาสตร์พื้นฐาน

การเลือกเครื่องมือและการเชื่อมต่อระบบสำหรับสถานพยาบาล

การเลือกระบบ AI สำหรับคลินิกหมายถึงการให้ความสำคัญกับสถาปัตยกรรมที่รักษาความปลอดภัยของข้อมูล มากกว่าความสามารถในการคุยเล่นแบบมนุษย์ทั่วไป เครื่องมือ AI สำเร็จรูปมักนำข้อมูลของคุณไปฝึกฝนโมเดลต่อ ซึ่งถือเป็นการละเมิดข้อมูลผู้ป่วยอย่างร้ายแรง

ในตลาดปัจจุบันมีเครื่องมือสามกลุ่มหลักคือ โมเดลภาษาขนาดใหญ่ (General LLMs) แพลตฟอร์ม AI สำหรับการแพทย์เฉพาะทาง (Healthcare-grade AI) และบอทแบบตอบตามกฎ (Rule-based bots) การเลือกใช้ให้ถูกประเภทจะช่วยประหยัดงบประมาณและลดความปวดหัวเรื่อง compliance ในระยะยาว

คลินิกที่ประสบความสำเร็จมักเลือกใช้ Healthcare-grade AI หรือ Rule-based bots ร่วมกับระบบ HIS ที่มีอยู่แล้ว แพลตฟอร์มอย่าง Zendesk ที่มีโมดูล HIPAA หรือเครื่องมือเฉพาะทางอย่าง Wysa และ Koko คือตัวเลือกที่ปลอดภัยกว่าการผูก API เข้ากับโมเดลสาธารณะโดยตรง

| คุณสมบัติ | บอทแบบตั้งกฎเกณฑ์ (Rule-based) | แพลตฟอร์ม AI ทางการแพทย์ (Healthcare-grade AI) | โมเดลภาษาทั่วไป (General LLMs) |

|---|---|---|---|

| ความปลอดภัยของข้อมูล (Privacy) | สูงมาก (ข้อมูลไม่ถูกส่งออก) | สูง (เข้ารหัสตามมาตรฐานสาธารณสุข) | ต่ำ (เสี่ยงต่อการถูกนำไปเทรนโมเดล) |

| ความสามารถในการเข้าใจบริบท | ต่ำ (ต้องพิมพ์ตรงคีย์เวิร์ด) | ปานกลางถึงสูง (เข้าใจบริบทสุขภาพจิต) | สูงมาก (แต่งเรื่องได้เนียนเกินไป) |

| ต้นทุนการติดตั้ง (Cost) | เริ่มต้น 5,000 บาท/เดือน | เริ่มต้น 30,000 บาท/เดือน | คิดตามปริมาณการใช้งาน (Token) |

| ความเสี่ยงในการให้คำแนะนำผิด | ไม่มี (ตอบตามสคริปต์ 100%) | ต่ำ (มี Guardrails ทางการแพทย์) | สูงมาก (ต้องเขียน Prompt ควบคุมเองทั้งหมด) |

| เหมาะสำหรับ | คลินิกขนาดเล็ก, งานแอดมินพื้นฐาน | โรงพยาบาล, คลินิกสุขภาพจิตขนาดกลางขึ้นไป | งานวิจัยระบบหลังบ้าน (ไม่ให้สัมผัสผู้ป่วย) |

การสร้างโปรโตคอลยกระดับเหตุฉุกเฉินและระบบตรวจสอบโดยมนุษย์

โปรโตคอลยกระดับเหตุฉุกเฉิน (Crisis Escalation Protocol) ทำหน้าที่เป็นเบรกฉุกเฉินภาคบังคับในระบบ AI สุขภาพจิตทุกรูปแบบ มันจะตัดการควบคุมจาก AI ทันทีและส่งสายตรงถึงเจ้าหน้าที่ที่เป็นมนุษย์เมื่อผู้ป่วยพิมพ์ข้อความที่บ่งบอกถึงความเสี่ยงสูง

การมี AI ไม่ได้หมายความว่าคุณจะเลิกจ้างคนดูแลคิวได้ แต่หมายถึงคนๆ นั้นจะมีเวลาโฟกัสเฉพาะเคสที่สำคัญจริงๆ เมื่อผู้ป่วยส่งสัญญาณความเครียดรุนแรง หรือมีความคิดทำร้ายตัวเอง ระบบจะต้องรู้ว่านี่ไม่ใช่เวลามาถามข้อมูลบัตรประชาชน แต่ต้องส่งต่อให้พยาบาลวิชาชีพทันที (Hand-off)

การออกแบบระบบให้ส่งต่อเคสได้ราบรื่นคือหัวใจสำคัญ หากผู้ป่วยต้องพิมพ์คำว่า "อยากตาย" แล้ว AI ยังตอบกลับว่า "กรุณารอเจ้าหน้าที่ 1 วันทำการ" คลินิกของคุณจะเจอกับวิกฤตความน่าเชื่อถือขั้นสูงสุด

คีย์เวิร์ดกระตุ้นการส่งต่อเหตุฉุกเฉิน

ระบบต้องถูกตั้งค่าให้สแกนหาคำศัพท์ต้องห้ามหรือความหมายแฝงที่บ่งบอกถึงอันตราย (Active vs Passive Ideation) ทันทีที่มีการพิมพ์เข้ามา

- คำศัพท์ตรงตัว: เช่น ฆ่าตัวตาย, ทำร้ายตัวเอง, ไม่เหลือใคร, ทนไม่ไหวแล้ว

- คำศัพท์แฝงความหมาย: เช่น อยากหายไป, ไม่มีใครต้องการ, เขียนจดหมายลา

- เมื่อตรวจพบ ระบบจะหยุดใช้ AI สร้างคำตอบ (Generative) ทันที

- ระบบจะส่งข้อความสคริปต์ตายตัวพร้อมเบอร์โทรสายด่วนสุขภาพจิต (เช่น 1323)

- ส่งแจ้งเตือนผ่าน SMS หรือแอปส่งข้อความภายใน (เช่น Slack/Teams) ไปยังพยาบาลเวรทันที

- หากไม่มีพยาบาลกดรับเคสภายใน 2 นาที ระบบจะโทรหาผู้อำนวยการคลินิกอัตโนมัติ

การกำกับดูแลโดยผู้ประกอบวิชาชีพเวชกรรม

ระบบ AI ต้องอยู่ภายใต้การดูแลของแพทย์ (Licensed professional oversight) เสมอ เพื่อรับรองว่ากระบวนการทั้งหมดได้มาตรฐานทางคลินิก

- จิตแพทย์หัวหน้าทีมต้องเป็นผู้อนุมัติชุดคำตอบมาตรฐานที่ AI ใช้ดึงมาตอบ

- มีการสุ่มตรวจ (Random Audit) ประวัติการแชทของ AI สัปดาห์ละ 20 เคสโดยมนุษย์

- เจ้าหน้าที่ธุรการต้องตรวจดู Dashboard เสมอว่ามีเคสไหนที่ AI ค้างการทำงานไว้หรือไม่

- ปรับปรุงฐานข้อมูลทุกเดือน เพื่อเพิ่มคีย์เวิร์ดใหม่ๆ ที่ผู้ป่วยใช้เรียกอาการ

- มีกระบวนการร้องเรียน (Feedback loop) ให้ผู้ป่วยกดรีพอร์ตหาก AI ทำงานผิดพลาด

แผนการติดตั้งระบบ AI ด้านสุขภาพจิตภายใน 90 วัน

แผนงาน healthcare ai 30 60 90 plan ที่ปลอดภัยที่สุดคือการถือว่าเดือนแรกเป็นช่วงเวลาทำงานแบบเงียบๆ (Shadow Phase) ที่ซ่อนจากสายตาผู้ป่วยโดยสิ้นเชิง มันช่วยลดความเสี่ยงโดยการทดสอบระบบกับข้อมูลในอดีตก่อนปล่อยให้สัมผัสกับผู้ป่วยจริง

การเร่งรีบเปิดตัว AI ในสัปดาห์เดียวมักจบลงด้วยความวุ่นวาย ทีมแพทย์จะต่อต้านเพราะรู้สึกว่าระบบเพิ่มภาระ การแบ่งการทำงานออกเป็นเฟสที่ชัดเจนช่วยให้ทุกฝ่ายมีเวลาปรับตัวและสร้างความมั่นใจในเครื่องมือใหม่

ผู้บริหารต้องสื่อสารให้ชัดเจนว่า AI มาเพื่อลดงานเอกสาร ไม่ได้มาแย่งงานแพทย์ กุญแจสำคัญคือการให้พยาบาลคัดกรองมีส่วนร่วมในการเทรน AI ตั้งแต่วันแรก เพื่อให้พวกเขาเป็นเจ้าของระบบ (Ownership)

- 30 วันแรก (เตรียมระบบและทดสอบแบบปิด): ติดตั้งระบบและเชื่อมต่อกับฐานข้อมูลเดิม นำประวัติแชทย้อนหลังมาทดสอบให้ AI จัดหมวดหมู่ (Shadowing) โดยยังไม่ตอบโต้กับผู้ป่วยจริง ทีมแอดมินตรวจสอบความถูกต้องของการจัดหมวดหมู่และปรับแต่ง (Tuning) ให้แม่นยำเกิน 95%

- 60 วันต่อมา (เปิดใช้งานเฉพาะงานธุรการ): เปิดให้ AI ตอบคำถามเฉพาะเรื่องเวลาทำงาน สถานที่ สิทธิประกัน และแพ็กเกจราคา สำหรับเรื่องอาการเจ็บป่วย AI จะส่งฟอร์มมาตรฐานให้กรอกและส่งต่อให้เจ้าหน้าที่ที่เป็นมนุษย์ทันที เก็บข้อมูลความพึงพอใจของผู้ป่วยในระยะนี้

- 90 วันและหลังจากนั้น (คัดกรองเบื้องต้นเต็มรูปแบบ): เปิดให้ AI ทำการคัดกรองอาการเบื้องต้นตามโครงสร้าง PHQ-9 หรือ GAD-7 ประเมินระดับความรุนแรงและจัดคิวนัดหมายลงตารางของแพทย์โดยอัตโนมัติ พร้อมทั้งเปิดใช้งานระบบโปรโตคอลรับมือเหตุฉุกเฉินเต็มรูปแบบ

การวัดผล ROI ทางธุรกิจโดยไม่ลดทอนคุณภาพการรักษา

ผลตอบแทนจากการลงทุน (ROI) ที่แท้จริงในคลินิกสุขภาพจิตมาจากจำนวนชั่วโมงทำงานของแพทย์ที่ได้กลับคืนมา ไม่ใช่มาจากการไล่พนักงานต้อนรับออก มันช่วยประหยัดเงินโดยการรับภาระงานธุรการที่เผาผลาญพลังงานของบุคลากรที่มีค่าจ้างสูงสุดของคุณ

การตั้งเป้าหมายว่าจะลดจำนวนพนักงานเพื่อคืนทุนค่า AI เป็นกรอบความคิดที่อันตรายและจะทำให้คุณภาพการดูแลผู้ป่วยแย่ลง คุณควรวัดผลว่า AI ช่วยให้แพทย์รับเคสบำบัดได้เพิ่มขึ้นกี่เคสต่อสัปดาห์ โดยที่แพทย์ไม่รู้สึกเหนื่อยล้าเพิ่มขึ้น

การวัดค่า roi metrics ที่ดีต้องสะท้อนถึงประสบการณ์ของผู้ป่วยที่ราบรื่นขึ้น หากระบบอัตโนมัติประหยัดเงินคลินิกได้เดือนละแสน แต่ทำให้ผู้ป่วยเก่ารำคาญจนย้ายคลินิก นั่นคือการลงทุนที่ล้มเหลว

การประหยัดต้นทุนการดำเนินงาน (Operational Savings)

ตัวเลขเหล่านี้คือสิ่งที่ CFO หรือผู้จัดการคลินิกต้องนำมาทำรายงานทุกสิ้นเดือนเพื่อพิสูจน์ความคุ้มค่า

- มูลค่าชั่วโมงการทำงาน (Billable hours) ของแพทย์ที่เพิ่มขึ้นจากการไม่ต้องตอบแชท

- ต้นทุนค่าจ้างล่วงเวลาของพยาบาลคัดกรองรอบดึกที่ลดลง

- ลดอัตราการโทรมาสอบถามทางโทรศัพท์ลง 40% ภายในสามเดือนแรก

- ลดเวลาเฉลี่ยในการตอบกลับครั้งแรก (Time to First Response) จาก 2 ชั่วโมงเหลือ 1 นาที

- อัตราการปฏิเสธเคลมประกันลดลง เพราะ AI ช่วยเก็บเอกสารสิทธิครบถ้วนตั้งแต่ต้น

การยกระดับการมีส่วนร่วมของผู้ป่วย (Patient Engagement)

ตัวชี้วัดฝั่งผู้ป่วยเป็นสิ่งยืนยันว่าเทคโนโลยีไม่ได้ทำลายความสัมพันธ์ระหว่างมนุษย์

- อัตราการกรอกประวัติก่อนพบแพทย์ (Pre-consultation form completion) เพิ่มสูงขึ้น

- จำนวนการผิดนัดหมาย (No-show rate) ลดลงเพราะระบบส่งแจ้งเตือนอัตโนมัติแม่นยำขึ้น

- ผู้ป่วยใหม่นอกเวลาทำการ (After-hours leads) ถูกแปลงเป็นคิวนัดหมายได้สำเร็จเพิ่มขึ้น 60%

- คะแนนความพึงพอใจเฉลี่ย (CSAT) อยู่ในระดับที่เทียบเท่าหรือดีกว่าการรอคุยกับคน

- อัตราการออกกลางคัน (Drop-off rate) ระหว่างแชทคุยเพื่อขอนัดหมายลดลง

ข้อผิดพลาดที่พบบ่อยที่สุดในการใช้ AI คัดกรองสุขภาพจิต

ข้อผิดพลาดทางเทคโนโลยีที่ราคาแพงที่สุดเกิดจากการที่คลินิกปฏิบัติกับผู้ป่วยสุขภาพจิตเหมือนเป็นลูกค้าปลีกทั่วไป คลินิกล้มเหลวเมื่อพวกเขาปล่อยบอทที่ฟังดูเห็นอกเห็นใจ (Empathetic) จนเกินไป แต่กลับไม่มีความสามารถทางคลินิกที่แท้จริงมารองรับ

ผู้ป่วยสุขภาพจิตกำลังมองหาความชัดเจนและความช่วยเหลือระดับมืออาชีพ ไม่ใช่บอทที่พยายามทำตัวเป็นเพื่อน การออกแบบ AI ให้พูดจาหวานหูเกินไปอาจทำให้ผู้ป่วยเข้าใจผิดว่ากำลังคุยกับนักจิตวิทยา และเริ่มเล่าปมปัญหาเชิงลึก ซึ่ง AI ไม่สามารถจัดการได้

การป้องกัน ai mental health support mistakes เริ่มต้นจากการออกแบบประสบการณ์ใช้งาน (UX) ที่ตรงไปตรงมา ความโปร่งใสคือรากฐานของความไว้วางใจ การหลอกให้ผู้ป่วยเชื่อว่าคุยกับคนอยู่คือการทำลายความเชื่อมั่นที่ไม่มีวันกู้คืนได้

การใช้งานโดยไม่มีมนุษย์สำรอง (Launching without human fallback)

นี่คือความผิดพลาดระดับหายนะที่ทำให้คลินิกถูกฟ้องร้อง

- ใช้บอทตอบคำถามนอกเวลาโดยไม่มีเบอร์โทรฉุกเฉินแนบไว้เลย

- ระบบวนลูป (Looping) ให้ผู้ป่วยพิมพ์คำถามซ้ำๆ เพราะบอทไม่เข้าใจบริบท

- ซ่อนปุ่ม "ติดต่อเจ้าหน้าที่" ไว้ยากเกินไป ทำให้ผู้ป่วยเกิดความหงุดหงิด

- ไม่ยอมกำหนดหน้าจอแจ้งเตือน (Dashboard alert) ให้แอดมินเห็นเวลาระบบคัดกรองล้มเหลว

- ปล่อยให้ AI ตอบตกลงเวลานัดหมาย ทั้งที่ตารางแพทย์จริงๆ เต็มแล้ว (Data Sync Error)

การละเลยกฎหมายความเป็นส่วนตัวในพื้นที่ (Ignoring Local Privacy Laws)

ความมักง่ายในการใช้เครื่องมือฟรีอาจจบลงด้วยค่าปรับมหาศาล

- ใช้ ChatGPT หรือเครื่องมือ LLM สาธารณะโดยไม่ได้เซ็นสัญญา Business Associate Agreement (BAA)

- เก็บประวัติการสนทนาสุขภาพจิตรวมไว้ในแพลตฟอร์มการตลาดทั่วไป (เช่น Hubspot แบบไม่ปรับแต่ง)

- ไม่มีขั้นตอนให้ผู้ป่วยกดให้ความยินยอมการประมวลผลข้อมูลสุขภาพ

- ส่งข้อมูลชื่อ นามสกุล และอาการผู้ป่วย ออกไปยังเซิร์ฟเวอร์ต่างประเทศโดยไม่เข้ารหัส

- ไม่มีนโยบายการลบข้อมูลทิ้ง (Data Retention Policy) เมื่อผู้ป่วยเลิกรักษา

ก้าวต่อไปในการวางระบบ AI Mental Health Workflow Implementation ของคุณ

ความสำเร็จในการทำ ai mental health workflow implementation เกิดจากการปฏิบัติต่อเทคโนโลยีนี้ในฐานะผู้ช่วยพนักงานธุรการ ไม่ใช่ผู้ให้บริการทางคลินิก มันปกป้องใบอนุญาตประกอบโรคศิลปะของคุณในขณะที่ช่วยขยายขีดความสามารถในการเข้าถึงผู้ป่วยของคลินิกได้อย่างยั่งยืน

เมื่อคุณออกแบบระบบที่กรองผู้ป่วยเข้าสู่อุโมงค์ที่ถูกต้อง ควบคุมความเสี่ยงด้วยโปรโตคอลฉุกเฉิน และเก็บรักษาข้อมูลอย่างรัดกุม คุณจะพบว่าปัญหาคอขวดที่เคยทำให้ทีมแพทย์ต้องปวดหัวนั้นหายไป คลินิกของคุณจะสามารถรองรับผู้ป่วยได้มากขึ้นโดยไม่ต้องเพิ่มชั่วโมงการทำงานที่เหนื่อยล้าให้กับบุคลากรเดิม

สิ่งที่คุณต้องทำพรุ่งนี้เช้าคือ นัดประชุมกับผู้จัดการคลินิกและพยาบาลคัดกรองของคุณ ให้พวกเขารวบรวมคำถามที่เจอบ่อยที่สุด 20 ข้อและสถานการณ์ฉุกเฉินที่เคยเกิดขึ้นจริงในรอบสามเดือนที่ผ่านมา ข้อมูลชุดแรกนี้คือจุดเริ่มต้นที่ทรงพลังที่สุดในการสร้างระบบคัดกรองอัตโนมัติที่ปลอดภัยและคุ้มค่าที่สุดสำหรับธุรกิจของคุณ