จัดการโค้ด Monorepo ขนาดใหญ่ด้วย Cursor Composer 2 และ Kimi Model

ค้นพบวิธีที่ทีมพัฒนาซอฟต์แวร์ระดับองค์กรในไทยสามารถแก้ปัญหา Legacy Code และ Refactor ระบบ Monorepo ขนาดใหญ่โดยใช้ Cursor Composer 2 with Kimi model เพื่อจัดการ Context Window ได้อย่างไร้ขีดจำกัด

iReadCustomer Team

ผู้เขียน

ทำไมองค์กรในไทยถึงต้องการ Long Context LLM Coding

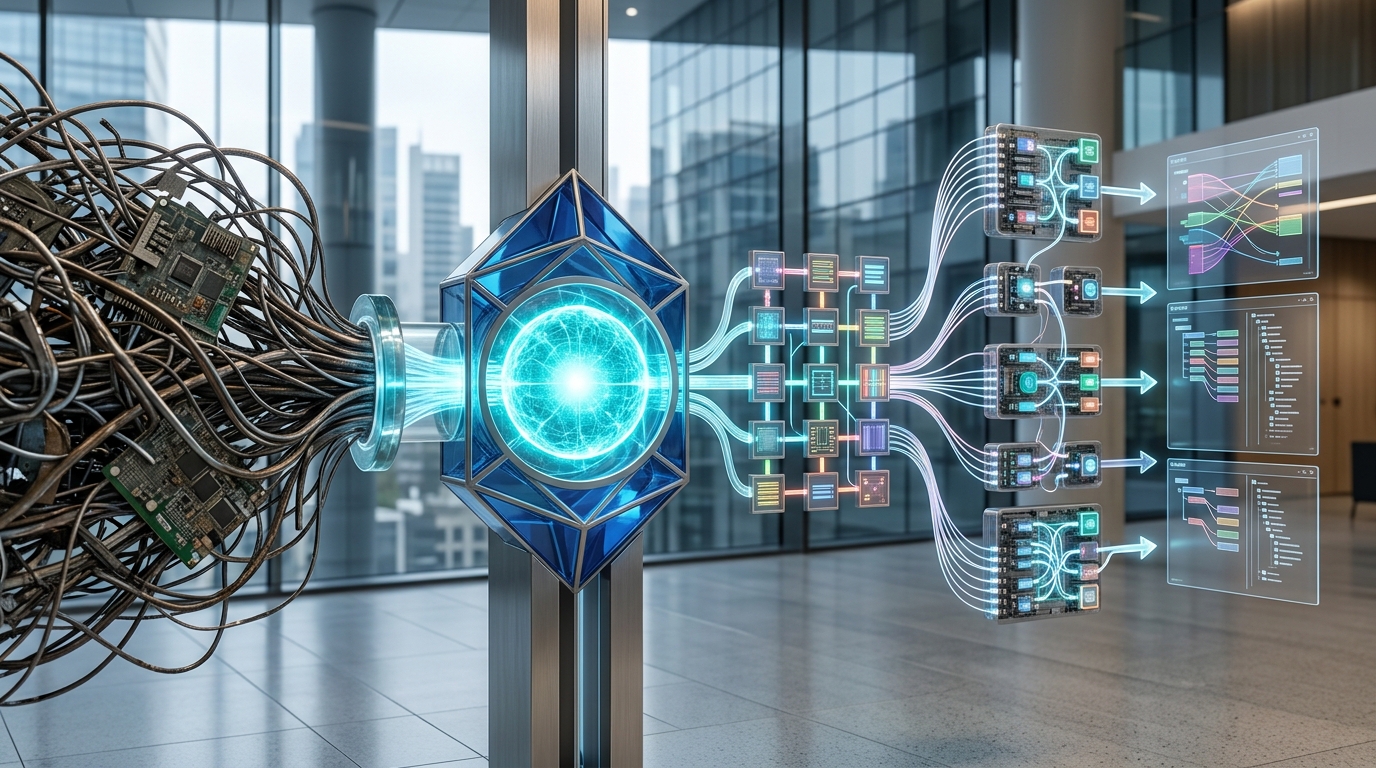

การนำ AI มาช่วยเขียนโค้ดไม่ใช่เรื่องใหม่ ทีมพัฒนาจำนวนมากคุ้นเคยกับการใช้เครื่องมือต่างๆ เช่น GitHub Copilot หรือ ChatGPT เพื่อสร้างฟังก์ชันย่อยๆ อย่างไรก็ตาม เมื่อพูดถึง refactoring enterprise monorepos ข้อจำกัดที่ใหญ่ที่สุดที่นักพัฒนาต้องเผชิญคือ "Context Window Limit"

โมเดล LLM ทั่วไปมักมีขีดจำกัดอยู่ที่ประมาณ 128k ถึง 200k tokens ซึ่งเพียงพอสำหรับการอ่านไฟล์ไม่กี่สิบไฟล์ แต่สำหรับโปรเจกต์ระดับองค์กรที่มี Dependencies, Configuration files, Database schemas และ Business logic ที่เชื่อมโยงกันอย่างซับซ้อน โมเดลเหล่านี้มักจะเกิดอาการ "Lost in the middle" หรือลืมข้อมูลที่อยู่ตรงกลางของ Prompt ทำให้โค้ดที่ถูกสร้างขึ้นมาใหม่ไม่สามารถทำงานร่วมกับระบบเดิมได้จริง

AI in software development การเข้ามาของ long context LLM coding จึงเป็นเหมือนจิ๊กซอว์ชิ้นสำคัญที่เข้ามาอุดช่องโหว่นี้ โดยเปิดโอกาสให้คุณโยนโค้ดทั้งโฟลเดอร์ให้ AI วิเคราะห์โครงสร้างและความสัมพันธ์ของโค้ด (AST - Abstract Syntax Tree) ได้อย่างแม่นยำ ลดภาระของ Senior Developer ในการไล่ตรวจสอบ Impact Analysis แบบแมนนวล

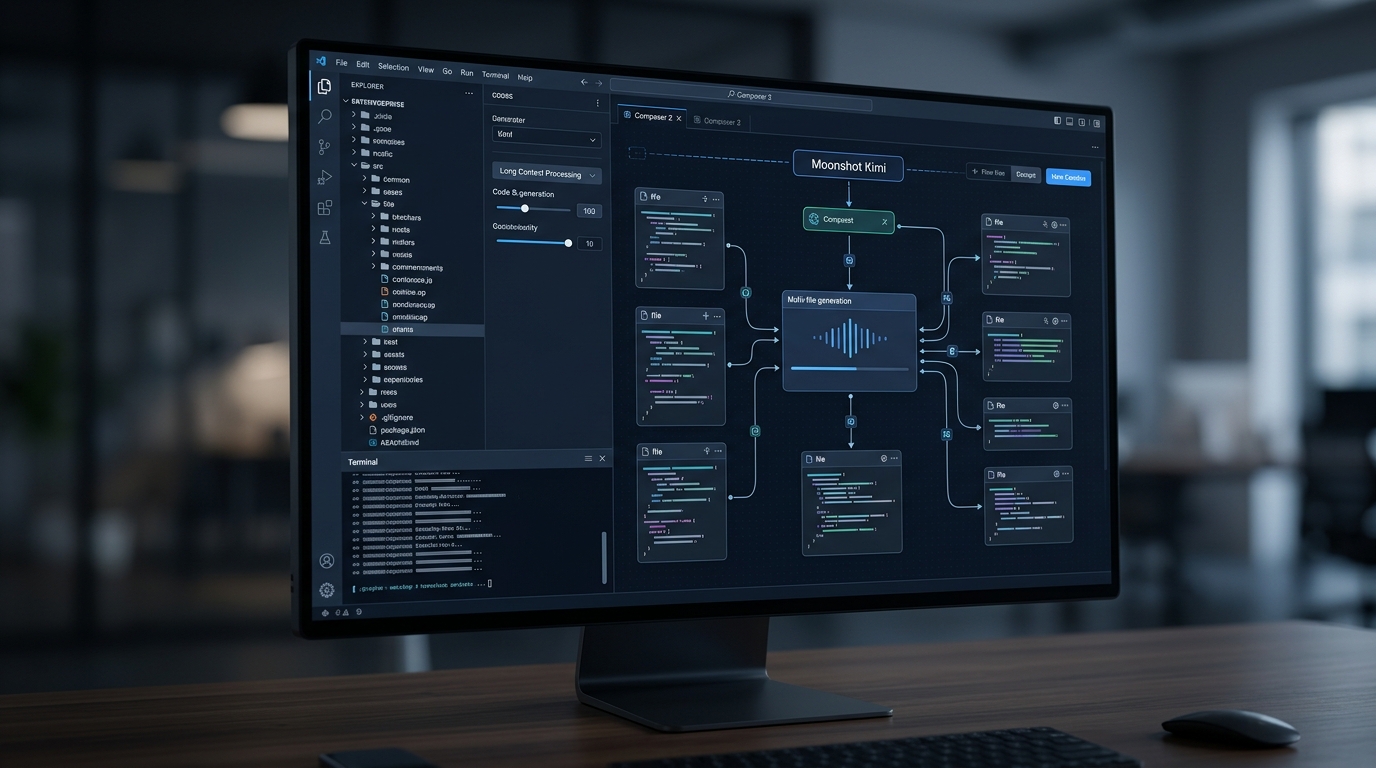

เจาะลึกความสามารถของ Cursor Composer 2 with Kimi model

การรวมพลังกันของเครื่องมือสองตัวนี้สร้าง Workflow ใหม่ที่เรียกว่า Agentic Software Engineering ซึ่งไม่ใช่แค่การ Auto-complete ทีละบรรทัด แต่เป็นการให้ AI ทำหน้าที่เป็นสถาปนิกซอฟต์แวร์

ความได้เปรียบของ Kimi Model ในการจัดการ Context Window

Kimi เป็นโมเดลที่พัฒนาโดย Moonshot AI integration ซึ่งโดดเด่นอย่างมากในเรื่องของการรองรับ Context Window ที่ยาวและมีความแม่นยำสูง (High Retrieval Accuracy) ในขณะที่โมเดลอื่นๆ อาจใช้วิธี RAG (Retrieval-Augmented Generation) ในการค้นหาบางส่วนของโค้ดมาวิเคราะห์ ซึ่งเสี่ยงต่อการพลาด Context ที่สำคัญ Kimi สามารถทำ "Full-context Loading" ได้ ทำให้มันเข้าใจการเรียกใช้ฟังก์ชันข้ามไฟล์ การทำ Dependency Injection หรือแม้แต่สไตล์การเขียนโค้ดของทีมได้อย่างครบถ้วน

Agentic Multi-File Orchestration ใน Composer 2

Cursor รุ่นล่าสุดได้เปิดตัว Composer 2 ซึ่งปรับเปลี่ยน UI และ UX สำหรับ AI-assisted coding ใหม่ทั้งหมด แทนที่จะคุยกับ AI ผ่านแผงแชทด้านข้าง Composer 2 ทำงานในลักษณะ Control Plane ที่คุณสามารถกด Ctrl+I หรือ Cmd+I เพื่อเรียกแผงคำสั่งขึ้นมา AI จะทำการคำนวณและเสนอการแก้ไข (Diffs) ในหลายๆ ไฟล์พร้อมกัน คุณสามารถเลือก Accept หรือ Reject ทีละไฟล์ได้ทันที ความสามารถนี้เมื่อจับคู่กับพลังการมองเห็นภาพกว้างของ Kimi ทำให้การย้าย โครงสร้างโปรเจกต์ หรือการอัปเดต API Version ใหม่ทั้งระบบกลายเป็นเรื่องที่ทำจบได้ในเวลาไม่กี่นาที

เวิร์กโฟลว์การใช้งานจริง: การ Refactor โค้ดระดับ Enterprise

เพื่อให้เห็นภาพชัดเจนยิ่งขึ้น ลองพิจารณาสถานการณ์ที่ทีมพัฒนาในบริษัท E-commerce ของไทยต้องการย้ายระบบคำนวณตะกร้าสินค้า (Cart Calculation) ที่อยู่ในไฟล์ Monolith ให้กลายเป็น Microservice ที่แยกออกมาชัดเจน

Step 1: Codebase Indexing และการจำกัดขอบเขต Context

แม้ Kimi จะรองรับ Context ได้มหาศาล แต่ Best Practice สำหรับ Cursor Composer 2 with Kimi model คือการใช้ฟีเจอร์ @Codebase ร่วมกับการระบุ Folder หรือประเภทไฟล์ที่เกี่ยวข้อง คุณสามารถเริ่มต้นโดยการพิมพ์:

@src/legacy/cart @src/models/product @src/utils/tax_calculator

การทำเช่นนี้จะดึงโค้ดที่เกี่ยวข้องทั้งหมดเข้าสู่ Context Window ของ Kimi ทันทีโดยไม่สูญเสียรายละเอียดใดๆ

Step 2: การออกแบบ Prompt สำหรับ Multi-File Refactoring

การเขียน Prompt สำหรับงานสเกลนี้ต้องมีความชัดเจนในเชิงสถาปัตยกรรม (Architecture-driven prompt) ตัวอย่างเช่น:

"Analyze the referenced cart calculation logic. Extract the discount calculation and tax logic into a new standalone Next.js service module under

/src/services/cart. Update all existing references in the UI components to use the new service via async API calls. Ensure TypeScript interfaces forCartItemare strictly typed and shared in/src/types/index.ts."

Step 3: การตรวจสอบและอนุมัติ Diffs

Cursor Composer 2 จะใช้ Kimi ในการวางแผนการทำงาน (Chain of Thought) จากนั้นจะเริ่มทะยอยสร้างไฟล์ใหม่ ลบโค้ดเดิมที่ซ้ำซ้อน และเพิ่มโค้ดในไฟล์ที่ได้รับผลกระทบ นักพัฒนาสามารถดู Inline Diffs ได้แบบเรียลไทม์ และด้วยความที่ Kimi จดจำ Context ได้ทั้งหมด ข้อผิดพลาดประเภท "Import path ผิด" หรือ "ลืมอัปเดตตัวแปรในไฟล์อื่น" จึงแทบจะไม่เกิดขึ้นเลย

ข้อพิจารณาด้านต้นทุนและความปลอดภัยสำหรับธุรกิจไทย

ความกังวลหลักขององค์กรขนาดใหญ่คือเรื่องความปลอดภัยของข้อมูล securing enterprise codebases การส่ง Source code นับล้านโทเค็นไปยังโมเดลภายนอกจำเป็นต้องผ่านกระบวนการตรวจสอบ Data Privacy Policy อย่างเคร่งครัด อย่างไรก็ตาม Cursor มีฟีเจอร์ Privacy Mode ที่ป้องกันไม่ให้นำโค้ดไปเทรนต่อ

ในด้านต้นทุน (Tokenomics) การใช้งาน refactoring enterprise monorepos ผ่านโมเดลระดับเรือธงที่มี Long Context อาจมีค่าใช้จ่าย API ที่สูงกว่าปกติ แต่เมื่อเปรียบเทียบกับจำนวนชั่วโมงทำงาน (Man-hours) ที่ทีมวิศวกรซอฟต์แวร์ต้องใช้เพื่อทำ Manual Refactoring ซึ่งอาจกินเวลาเป็นสัปดาห์หรือเป็นเดือน ROI (Return on Investment) ที่ได้จากการใช้ Kimi model จะแสดงให้เห็นถึงความคุ้มค่าอย่างชัดเจน

บทสรุป

การก้าวข้ามขีดจำกัดเดิมๆ ของการจัดการโค้ดเบสขนาดใหญ่ไม่ใช่เรื่องที่เป็นไปไม่ได้อีกต่อไป การนำ Cursor Composer 2 with Kimi model เข้ามาเป็นผู้ช่วยในการทำ long context LLM coding ช่วยปลดล็อกคอขวดในการพัฒนาซอฟต์แวร์ขององค์กรได้อย่างเป็นรูปธรรม ทำให้ทีมพัฒนาในประเทศไทยสามารถรับมือกับหนี้ทางเทคนิค และเร่งรอบการส่งมอบฟีเจอร์ใหม่ (Time-to-market) สู่มือผู้ใช้งานได้อย่างมั่นคงและปลอดภัยมากยิ่งขึ้น

FAQ

Cursor Composer 2 ต่างจาก GitHub Copilot อย่างไร?

Composer 2 ถูกออกแบบมาเพื่อทำหน้าที่ระดับ Agent (Multi-file orchestration) ที่สามารถวิเคราะห์ เสนอการแก้ไข สร้างไฟล์ใหม่ และปรับโครงสร้างทั้งโปรเจกต์ได้พร้อมกัน ในขณะที่ Copilot เดิมมักจะเก่งในการคาดเดาและเติมโค้ดบรรทัดต่อไปในไฟล์ที่กำลังเปิดอยู่

Kimi Model มีความปลอดภัยเพียงพอสำหรับ Source Code ของธนาคารหรือองค์กรใหญ่หรือไม่?

การใช้งานผ่าน Cursor ในระดับ Pro หรือ Enterprise จะมีฟีเจอร์ Privacy Mode ซึ่งรับประกันว่าจะไม่มีการจัดเก็บโค้ดเบสของคุณไว้ หรือนำไปใช้ฝึกฝน (Train) โมเดลต่อ อย่างไรก็ตาม องค์กรควรพิจารณานโยบาย Data Governance ภายในของตนร่วมด้วย

การใช้งาน Long Context สิ้นเปลือง API Credit มากน้อยแค่ไหน?

ยิ่ง Context มีขนาดใหญ่ จำนวน Token ที่ต้องประมวลผลก็จะสูงขึ้นตาม ทำให้ค่าใช้จ่ายต่อหนึ่ง Prompt สูงกว่าปกติ แนะนำให้ใช้วิธีรวมไฟล์เฉพาะที่เกี่ยวข้อง หรือใช้ฟีเจอร์ @Codebase ในขอบเขตจำกัดเพื่อให้ได้ผลลัพธ์ที่ดีที่สุดในราคาที่คุ้มค่า